Etik helt ind i maskinrummet

Sådan arbejder vi med magt, bias og ansvarlighed i vores brug af AI, data og digitale værktøjer.

Når vi udvikler digitale redskaber til borgerinddragelse, analyserer kvalitative data med AI eller visualiserer tusindvis af stemmer i et enkelt kort, træffer vi valg. Valg om, hvem der kan deltage, hvad der tæller som viden, hvilke mønstre der bliver synlige, og hvilke der forsvinder. Ingen af disse er neutrale eller rent tekniske valg. De er etiske og politiske, og de har direkte konsekvenser for, hvilke stemmer der høres, og hvilke beslutninger der træffes på baggrund af vores arbejde. Etik er derfor ikke et tillæg til det, vi laver. Det er en forudsætning, som er bagt ind fra start i selve maskinrummet.

Vores tilgang til etik og tech

Ansvarlig brug af AI kommer ikke fra en tjekliste. Det kommer fra en kultur, hvor de svære spørgsmål stilles igen og igen – om bias, om magt, om hvem der høres, og hvem der overses. For os er etik ikke et lag, man lægger ovenpå et færdigt produkt. Det er en løbende praksis, en kritisk refleksionsevne, der skal trænes og bruges aktivt i hverdagen for at holde sig skarp. Her kan du se, hvad der kendetegner vores tilgang.

-

Vi begynder ikke et projekt og tilføjer etiske overvejelser bagefter. Fra første designvalg indtænker vi, hvad vores redskaber må og ikke må bruges til. Ansigter sløres automatisk i Involve, brugerne har fuld kontrol over deres data, og kommercielle aktører kan ikke træne på det materiale, vi indsamler og behandler, når vi bruger Model for Vilde Problemer til analyse.

-

Vores redskaber er ikke udviklet i enerum. Involve appen er bygget oven på en åben kodebase fra Urban Belonging-appen, udviklet i samspil med forskere og syv minoritetsgrupper i Danmark og vinder af EU Citizen Science Award 2023. Og appen er testet i praksis i en bred brugergruppe via en åben invitation til alle, der følger INVI’s nyhedsbrev. Model for Vilde Problemer er udviklet med en uafhængig følgegruppe af eksperter fra forskning, civilsamfund og erhvervsliv. Dem, der skal bruge vores værktøjer og kan udfordre vores redskaber, er med fra begyndelsen.

-

Vores team er tværfagligt og mangfoldigt, og de redskaber vi bygger afspejler de mennesker, der bygger dem. I de undersøgelser vi gennemfører insisterer vi på at invitere hele spektret af berørte stemmer med. De mest afgørende indsigter om et problem sidder ofte hos dem, der lever med det, ikke hos dem, der administrerer det.

-

Vi tester løbende vores metoder med eksterne forskere og publicerer resultaterne. Det er ikke kvalitetssikring som tjekliste. Det er kvalitetssikring som løbende praksis, der sikrer at vi hele tiden bliver udfordret og informereret af, hvad de dygtigste forskere inden for brug af AI arbejder på.

-

Vi er eksplicitte om de teknologiske afhængigheder, vores arbejde hviler på – herunder hvilke modeller vi bruger, og hvad vi ikke kan se ind i. Vores svar på den mangel på transparens og forklarlighed, som ofte kan følge med brug af især store sprogmodeller, er ikke at lukke øjnene, men at bidrage aktivt til at feltet får bedre redskaber til at vurdere og sammenligne modeller.

Vi forankrer etikarbejdet i forskning

Arbejde med etiske dilemmaer bliver stærkere, når det møder kritiske blikke udefra. Vi opsøger derfor de forskningsmiljøer i og udenfor Danmark, der er længst fremme i arbejdet med teknologi, magt og demokrati og bringer indsigterne hjem til vores praksis.

Se eksempler på projekter og forskningsbesøg nedenfor.

Har du en idé til en workshop, et forskningsprojekt eller en debat, der kan gøre os klogere på svære spørgsmål omkring AI og etik, så skriv til os! Vi vil meget gerne høre, hvad ideen går ud på, og se om vi kan finde på noget, der gør os klogere i fællesskab.

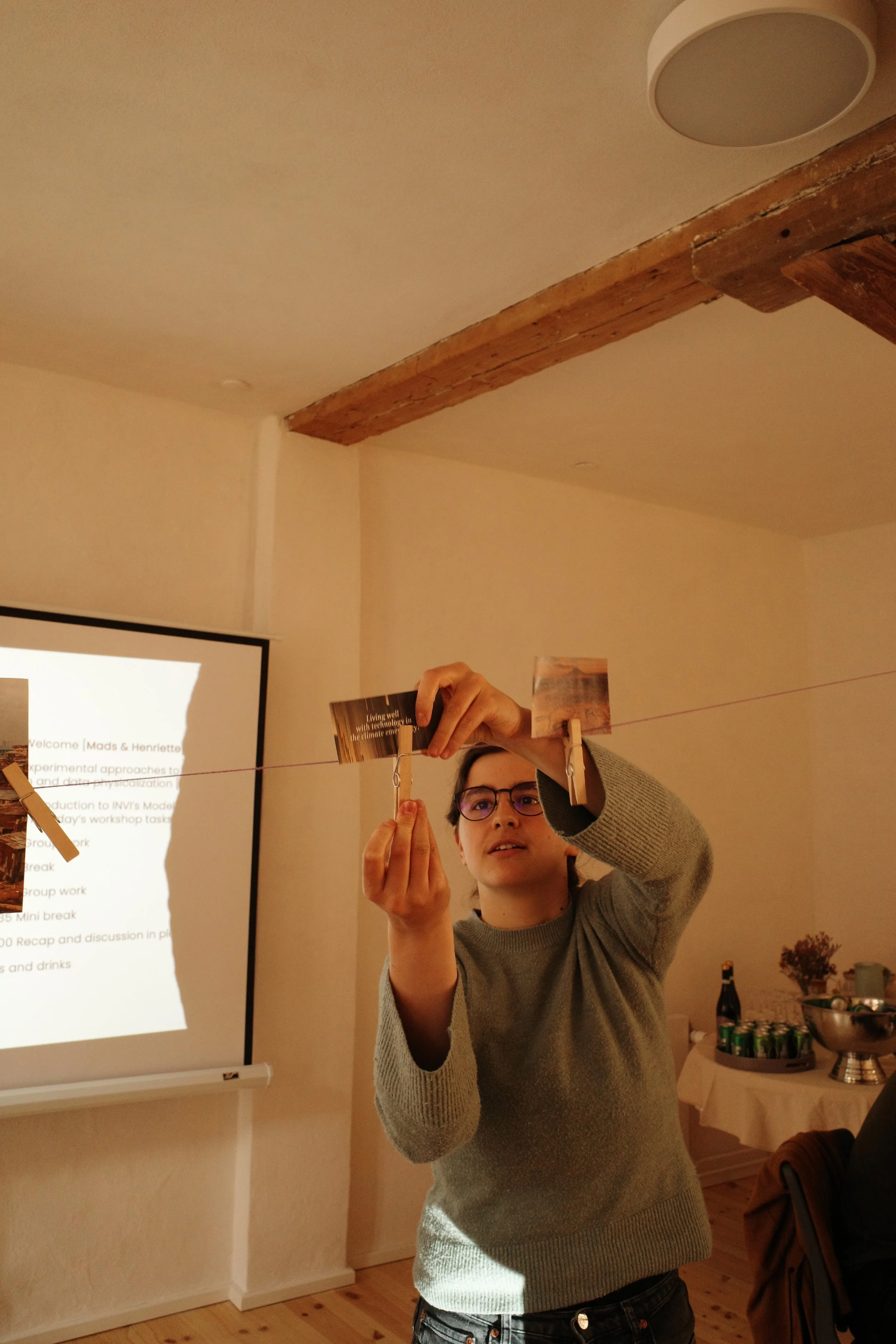

Snapshots

Fotos fra ‘Doing AI Otherwise’ workshopserien med ITU’s ETHOS Lab.

Hvad henter vi inspiration i?

Vores tilgang til dataetik er ikke udviklet i et vakuum. Vi trækker på en række kritiske og feministiske forskningstraditioner, der har udfordret forestillingen om teknologi som neutral og objektiv.

-

Med afsæt i Catherine D'Ignazio og Lauren Kleins arbejde stiller vi kritiske spørgsmål til magtforhold og diskrimination i datadrevne projekter. Hvem repræsenteres i vores data– og hvem udelades? Hvem drager fordel af de indsigter, vi producerer? Hvordan kan vi bruge data positivt til at udfordre, frem for forstærke, etablerede kategoriseringer og fasttømrede binære klassifikationer? Det er spørgsmål, der former vores design fra starten.

Se Data Feminism (2020) her, og find inspiration i arbejdet hos Data + Feminism Lab på MIT her. -

Inspireret af Sasha Costanza-Chocks framework arbejder vi med at sikre, at de mennesker, der oftest bærer konsekvenserne af teknologiske beslutninger, også har en reel stemme i, hvordan vores vores analyseværktøjer og dataprojekter designes og bruges til at træffe beslutninger med.

Når vi skal til at lave et analyseprojekt om Ungeløftet, så sørger vi f.eks. for at involvere de unge selv i evaluering af de spørgsmål vi stiller, inden vi påbegynder undersøgelsen. Og når vi laver digitale værktøjer såsom Involve appen sørger vi for at teste tilgængelighed og anvendelighed med forskellige brugergrupper og inkorporerer deres behov og feedback i værktøjets udvikling.

Find ‘Design Justice’ (2018) som open-access ressource hos MIT Press her.

-

Vi anerkender, at data ikke er rå facts, men altid allerede fortolkede størrelser, der er formet af de systemer, kategorier og magtforhold, de opstår i. Inden for Science and Technology Studies (STS) og kritiske datastudier er det veldokumenteret, hvordan teknologiske systemer indlejrer og forstærker eksisterende sociale hierarkier – ofte usynligt og tilsyneladende objektivt. Det gør os mere forsigtige med, hvad vi konkluderer, og mere eksplicitte om vores metodiske valg.

Vi trækker særligt på: Kate Crawfords Atlas of AI (2021), der kortlægger de politiske, miljømæssige og sociale omkostninger ved AI-infrastruktur; Raw Data is an Oxymoron (red. Gitelman, 2013), der viser hvordan data altid er konstrueret snarere end givet; Meredith Broussards Artificial Unintelligence (2018) om de systematiske blinde vinkler i teknologisk problemløsning; samt klassiske STS-bidrag fra Sheila Jasanoff om sociotechnical imaginaries og Langdon Winners spørgsmål om, hvorvidt artefakter har politik.

-

Datavisualiseringer er aldrig neutrale repræsentationer af virkeligheden. De er altid resultatet af valg: om hvad der inkluderes og udelades, hvordan fænomener afgrænses og navngives, og hvilke perspektiver der privilegeres. Inden for kritisk kartografi og kulturel geografi er det veldokumenteret, at selv tilsyneladende objektive kort og visualiseringer er politiske dokumenter, der former, hvad vi ser som naturligt, sandt og muligt. Det gælder ikke mindre for de store plottede kort, vi producerer, når vi visualiserer tusindvis af borgeres og praktikeres udsagn om samfundsproblemer. Hvilke stemmer ender i centrum af kortet, og hvilke placeres i periferien? Hvilke udsagn klumper vi sammen i samme klynge, og hvad mister vi, når vi gør det?

Vi trækker særligt på Martin Dodge, Rob Kitchin og Chris Perkins' Rethinking Maps (2009), der viser hvordan kort aldrig blot afbilder verden, men aktivt konstruerer den gennem de valg, der træffes i processen; Denis Woods The Power of Maps (1992), der undersøger, hvordan kortets tilsyneladende objektivitet skjuler de interesser og perspektiver, der har formet det; samt J.B. Harleys Deconstructing the Map (1989), der med inspiration fra Foucault og Derrida åbner for en kritisk læsning af, hvad et kort inkluderer, ekskluderer og normaliserer. Harveys bredere arbejde om, hvordan rum og repræsentation er uløseligt forbundet med magt, informerer desuden vores bevidsthed om, at det aldrig er tilfældigt, hvilke forståelser af et problem der får plads i vores visualiseringer.

Det forpligter os til løbende at spørge: Hvad usynliggør vores visualiseringer? Hvilke kategorier og afgrænsninger har vi valgt, og hvad havde vi set, hvis vi havde valgt anderledes?

Vi deler vores viden i en Masterclass

Vi mener, at etisk arbejde med AI ikke bør være forbeholdt forskere eller de organisationer, der har mange ressourcer til at tænke det igennem. Derfor tilbyder vi AI Etik i Praksis; et kursus udviklet og undervist af INVI’s Chefanalytiker, Sofie Burgos-Thorsen, i samarbejde med forsker Tess Skadegaard Thorsen, der giver ledere og andre med ansvar for brug af AI i deres organisation konkrete kompetencer og redskaber til at identificere og håndtere etiske dilemmaer i brugen af AI.

Udviklingen af kurset er støttet af Danish Data Science Academy og afvikles for første gang i Foråret 2026.